Quels sont les nouveaux rôles à faire émerger dans un fonds avec l'IA et la Data ?

L’introduction de l’IA et de la Data dans un fonds ne crée pas une rupture brutale des métiers, mais fait émerger de nouveaux rôles autour de la structuration de la donnée, de la gouvernance et de l’usage opérationnel.

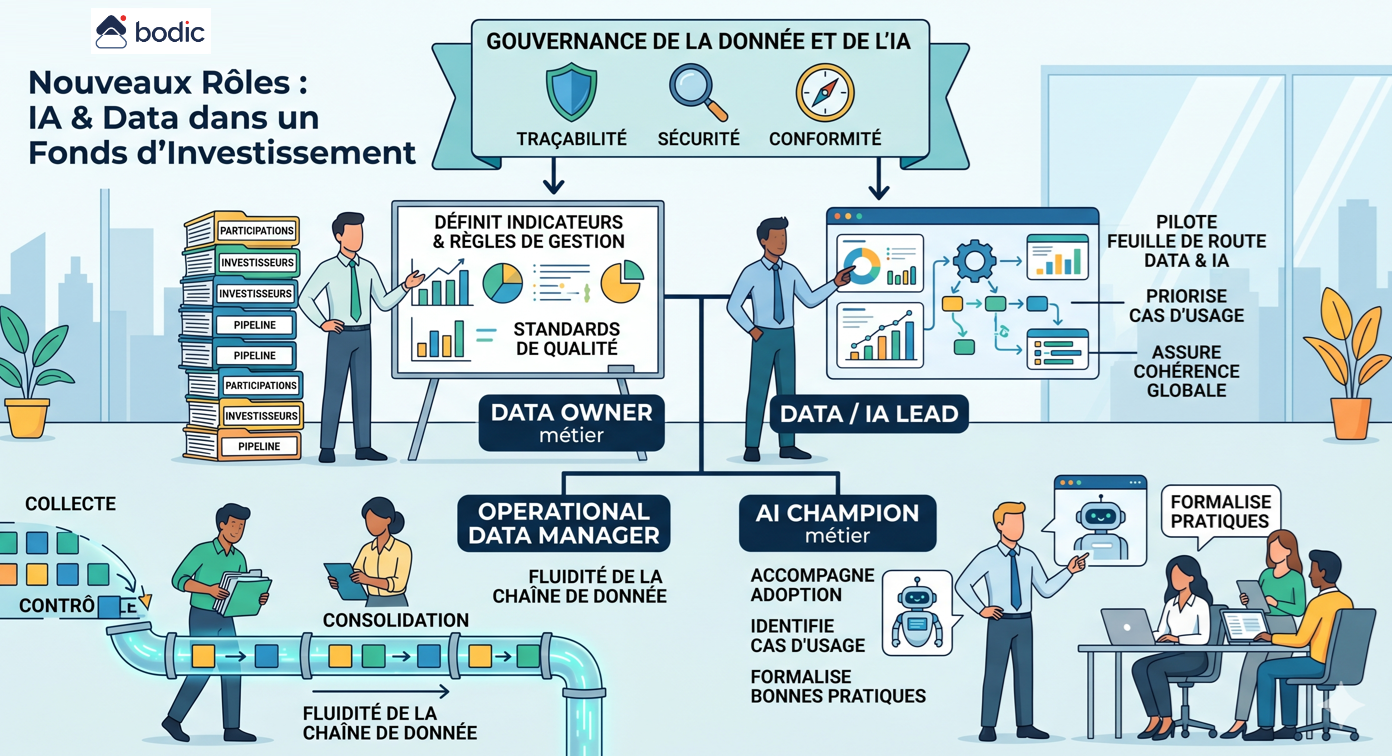

Le premier rôle clé est celui de Data Owner métier. Il porte la responsabilité d’un périmètre de données critique, par exemple les participations, les investisseurs ou le pipeline. Il définit les indicateurs, les règles de gestion, les formats attendus et les standards de qualité. Sans ce rôle, la donnée reste diffuse et difficilement exploitable.

Le second rôle est celui de Data / IA Lead. Il pilote la feuille de route Data et IA du fonds, priorise les cas d’usage, arbitre les choix d’outils et assure la cohérence globale. Il agit comme un point de convergence entre les équipes d’investissement, le Middle Office, l’IR et les fonctions support.

Un troisième rôle émerge autour de l’Operational Data Manager. Il se situe au cœur des opérations, souvent au Middle Office, et s’assure que les flux de données sont correctement collectés, contrôlés, consolidés et diffusés. Il est responsable de la qualité opérationnelle et de la fluidité de la chaîne de donnée.

Avec l’IA, apparaît également un rôle plus spécifique d’AI Champion métier. Ce profil n’est pas nécessairement technique, mais il maîtrise les outils et leurs usages. Il accompagne les équipes dans l’adoption, identifie les cas d’usage pertinents et formalise les bonnes pratiques, notamment sur la supervision et les limites des agents IA.

Enfin, un rôle transverse de Gouvernance de la donnée et de l’IA devient indispensable. Il couvre les sujets de traçabilité, de sécurité, de conformité et de contrôle. Dans un contexte LP et réglementaire, la capacité à expliquer une donnée ou une décision devient aussi importante que la produire.

Il n’est pas nécessaire de structurer immédiatement une équipe dédiée. Dans la plupart des fonds, ces rôles émergent progressivement à partir des équipes existantes. L’enjeu est d’identifier les responsabilités, de clarifier les périmètres et de structurer une montée en compétence ciblée.

Le point clé reste l’ancrage métier. Ces rôles ne doivent pas être isolés dans une logique purement technique, mais intégrés au cœur des processus d’investissement et de gestion. C’est cette proximité qui permet de transformer la donnée en levier réel de performance.

Le premier rôle clé est celui de Data Owner métier. Il porte la responsabilité d’un périmètre de données critique, par exemple les participations, les investisseurs ou le pipeline. Il définit les indicateurs, les règles de gestion, les formats attendus et les standards de qualité. Sans ce rôle, la donnée reste diffuse et difficilement exploitable.

Le second rôle est celui de Data / IA Lead. Il pilote la feuille de route Data et IA du fonds, priorise les cas d’usage, arbitre les choix d’outils et assure la cohérence globale. Il agit comme un point de convergence entre les équipes d’investissement, le Middle Office, l’IR et les fonctions support.

Un troisième rôle émerge autour de l’Operational Data Manager. Il se situe au cœur des opérations, souvent au Middle Office, et s’assure que les flux de données sont correctement collectés, contrôlés, consolidés et diffusés. Il est responsable de la qualité opérationnelle et de la fluidité de la chaîne de donnée.

Avec l’IA, apparaît également un rôle plus spécifique d’AI Champion métier. Ce profil n’est pas nécessairement technique, mais il maîtrise les outils et leurs usages. Il accompagne les équipes dans l’adoption, identifie les cas d’usage pertinents et formalise les bonnes pratiques, notamment sur la supervision et les limites des agents IA.

Enfin, un rôle transverse de Gouvernance de la donnée et de l’IA devient indispensable. Il couvre les sujets de traçabilité, de sécurité, de conformité et de contrôle. Dans un contexte LP et réglementaire, la capacité à expliquer une donnée ou une décision devient aussi importante que la produire.

Il n’est pas nécessaire de structurer immédiatement une équipe dédiée. Dans la plupart des fonds, ces rôles émergent progressivement à partir des équipes existantes. L’enjeu est d’identifier les responsabilités, de clarifier les périmètres et de structurer une montée en compétence ciblée.

Le point clé reste l’ancrage métier. Ces rôles ne doivent pas être isolés dans une logique purement technique, mais intégrés au cœur des processus d’investissement et de gestion. C’est cette proximité qui permet de transformer la donnée en levier réel de performance.