Welche neuen Rollen müssen in einem Fonds mit KI und Data entstehen?

Die Einführung von KI und Data in einem Fonds führt nicht zu einem abrupten Bruch in den Berufen, sondern lässt neue Rollen rund um die Strukturierung der Daten, die Governance und die operative Nutzung entstehen.

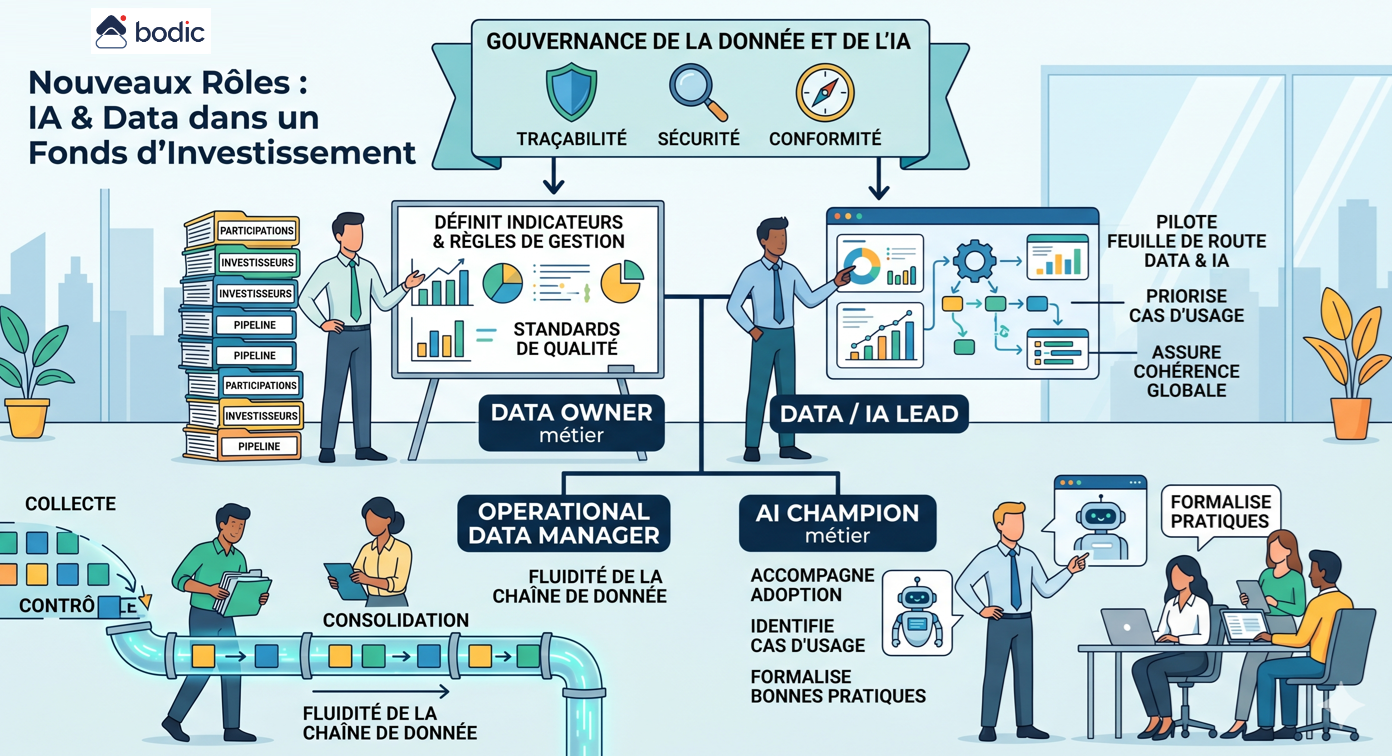

Die erste Schlüsselrolle ist die des fachlichen Data Owners. Er trägt die Verantwortung für einen kritischen Datenumfang, z. B. Beteiligungen, Investoren oder die Pipeline. Er definiert die Indikatoren, die Verwaltungsregeln, die erwarteten Formate und die Qualitätsstandards. Ohne diese Rolle bleiben die Daten diffus und schwer verwertbar.

Die zweite Rolle ist die des Data / AI Lead. Er steuert die Data- und AI-Roadmap des Fonds, priorisiert die Anwendungsfälle, entscheidet über die Wahl der Tools und gewährleistet die globale Kohärenz. Er fungiert als Konvergenzpunkt zwischen den Investmentteams, dem Middle Office, der IR und den Unterstützungsfunktionen.

Eine dritte Rolle entsteht rund um den Operational Data Manager. Er befindet sich im Zentrum der Operationen, häufig im Middle Office, und stellt sicher, dass die Datenströme korrekt gesammelt, kontrolliert, konsolidiert und verbreitet werden. Er ist für die operative Qualität und den reibungslosen Ablauf der Datenkette verantwortlich.

Mit der KI entsteht auch eine spezifischere Rolle des KI-Berufschampions. Dieses Profil muss nicht unbedingt technisch sein, aber es beherrscht die Werkzeuge und ihre Nutzung. Es begleitet die Teams bei der Einführung, identifiziert relevante Anwendungsfälle und formalisiert bewährte Verfahren, insbesondere in Bezug auf die Überwachung und die Grenzen von KI-Agenten.

Schließlich wird eine übergreifende Rolle der Daten- und KI-Governance unerlässlich. Sie deckt die Themen Rückverfolgbarkeit, Sicherheit, Einhaltung und Kontrolle ab. In einem LP- und Regulierungskontext wird die Fähigkeit, Daten oder Entscheidungen zu erklären, genauso wichtig wie sie zu produzieren.

Es ist nicht notwendig, sofort ein dediziertes Team zu strukturieren. In den meisten Fonds entstehen diese Rollen allmählich aus den bestehenden Teams. Die Herausforderung besteht darin, die Verantwortlichkeiten zu identifizieren, den Umfang zu klären und einen gezielten Kompetenzaufbau zu strukturieren.

Der Schlüsselpunkt bleibt die fachliche Verankerung. Diese Rollen dürfen nicht in einer rein technischen Logik isoliert werden, sondern müssen in den Kern der Investitions- und Verwaltungsprozesse integriert werden. Es ist diese Nähe, die es ermöglicht, Daten in einen echten Leistungshebel zu verwandeln.

Die erste Schlüsselrolle ist die des fachlichen Data Owners. Er trägt die Verantwortung für einen kritischen Datenumfang, z. B. Beteiligungen, Investoren oder die Pipeline. Er definiert die Indikatoren, die Verwaltungsregeln, die erwarteten Formate und die Qualitätsstandards. Ohne diese Rolle bleiben die Daten diffus und schwer verwertbar.

Die zweite Rolle ist die des Data / AI Lead. Er steuert die Data- und AI-Roadmap des Fonds, priorisiert die Anwendungsfälle, entscheidet über die Wahl der Tools und gewährleistet die globale Kohärenz. Er fungiert als Konvergenzpunkt zwischen den Investmentteams, dem Middle Office, der IR und den Unterstützungsfunktionen.

Eine dritte Rolle entsteht rund um den Operational Data Manager. Er befindet sich im Zentrum der Operationen, häufig im Middle Office, und stellt sicher, dass die Datenströme korrekt gesammelt, kontrolliert, konsolidiert und verbreitet werden. Er ist für die operative Qualität und den reibungslosen Ablauf der Datenkette verantwortlich.

Mit der KI entsteht auch eine spezifischere Rolle des KI-Berufschampions. Dieses Profil muss nicht unbedingt technisch sein, aber es beherrscht die Werkzeuge und ihre Nutzung. Es begleitet die Teams bei der Einführung, identifiziert relevante Anwendungsfälle und formalisiert bewährte Verfahren, insbesondere in Bezug auf die Überwachung und die Grenzen von KI-Agenten.

Schließlich wird eine übergreifende Rolle der Daten- und KI-Governance unerlässlich. Sie deckt die Themen Rückverfolgbarkeit, Sicherheit, Einhaltung und Kontrolle ab. In einem LP- und Regulierungskontext wird die Fähigkeit, Daten oder Entscheidungen zu erklären, genauso wichtig wie sie zu produzieren.

Es ist nicht notwendig, sofort ein dediziertes Team zu strukturieren. In den meisten Fonds entstehen diese Rollen allmählich aus den bestehenden Teams. Die Herausforderung besteht darin, die Verantwortlichkeiten zu identifizieren, den Umfang zu klären und einen gezielten Kompetenzaufbau zu strukturieren.

Der Schlüsselpunkt bleibt die fachliche Verankerung. Diese Rollen dürfen nicht in einer rein technischen Logik isoliert werden, sondern müssen in den Kern der Investitions- und Verwaltungsprozesse integriert werden. Es ist diese Nähe, die es ermöglicht, Daten in einen echten Leistungshebel zu verwandeln.