Quali nuovi ruoli stanno emergendo in un fondo con AI e dati?

L'introduzione dell'IA e dei dati in un fondo non comporta un cambiamento repentino delle linee di business, ma dà origine a nuovi ruoli per quanto riguarda la strutturazione, la governance e l'utilizzo operativo dei dati.

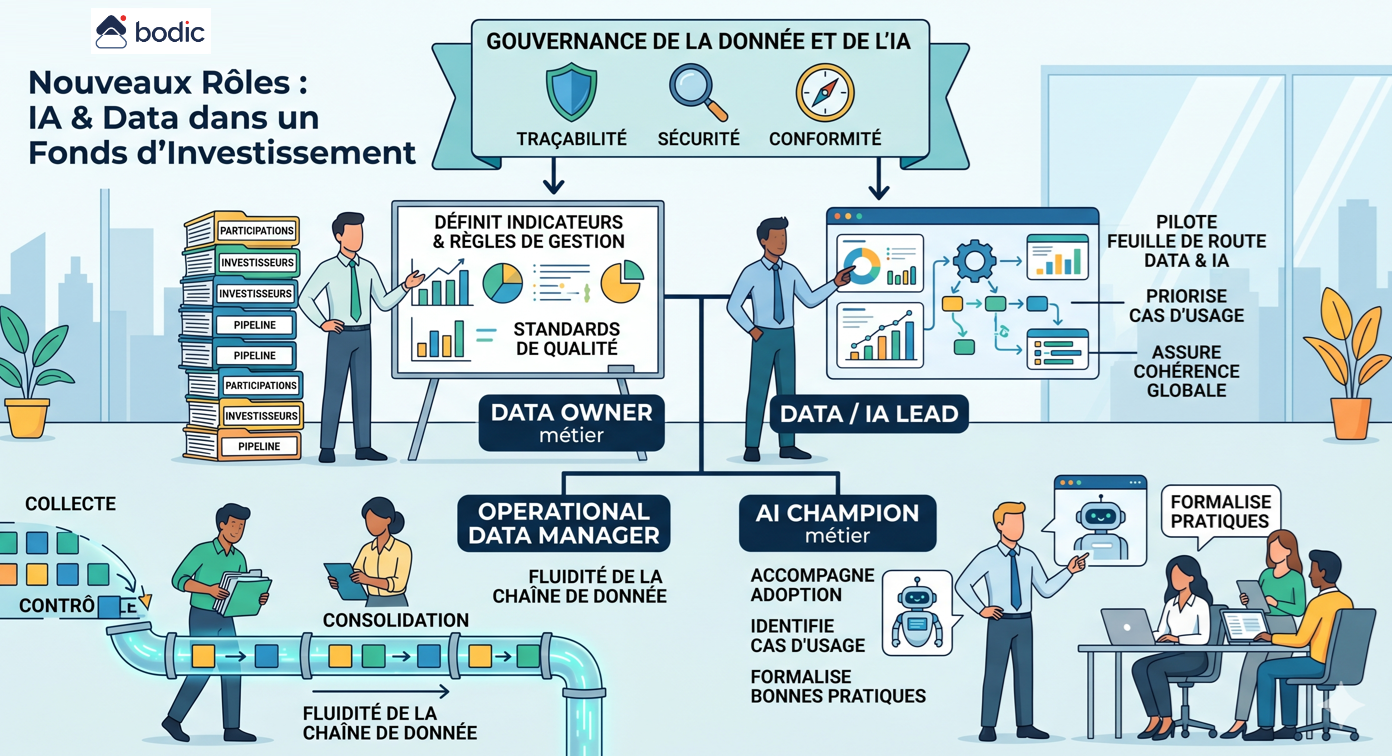

Il primo ruolo chiave è quello del Data Owner aziendale. È responsabile di un perimetro critico di dati, come le partecipazioni, gli investitori o la pipeline. Definisce gli indicatori, le regole di gestione, i formati previsti e gli standard di qualità. Senza questo ruolo, i dati rimangono diffusi e difficili da sfruttare.

Il secondo ruolo è quello di Data / AI Lead. Guida la roadmap dei dati e dell'IA del fondo, stabilisce le priorità dei casi d'uso, arbitra la scelta degli strumenti e garantisce la coerenza generale. Agisce come punto di convergenza tra i team di investimento, il Middle Office, l'IR e le funzioni di supporto.

Un terzo ruolo sta emergendo intorno all'Operational Data Manager. Si trova nel cuore delle operazioni, spesso nel Middle Office, e garantisce che i flussi di dati siano raccolti, controllati, consolidati e diffusi correttamente. È responsabile della qualità operativa e della fluidità della catena dei dati.

Con l'IA, sta emergendo anche un ruolo più specifico di Business AI Champion. Non si tratta necessariamente di un profilo tecnico, ma di uno che padroneggia gli strumenti e il loro utilizzo. Aiuta i team ad adottare l'IA, a identificare i casi d'uso rilevanti e a formalizzare le best practice, in particolare per quanto riguarda la supervisione e i limiti degli agenti di IA.

Infine, sta diventando essenziale un ruolo interfunzionale per la governance dei dati e dell'IA. Ciò riguarda la tracciabilità, la sicurezza, la conformità e il controllo. In un contesto LP e normativo, la capacità di spiegare i dati o le decisioni sta diventando importante quanto la loro produzione.

Non è necessario creare immediatamente un team dedicato. Nella maggior parte dei fondi, questi ruoli emergono gradualmente dai team esistenti. La sfida consiste nell'individuare le responsabilità, chiarire gli ambiti e strutturare uno sviluppo mirato delle competenze.

Il punto chiave è garantire che siano radicati nell'azienda. Questi ruoli non devono essere isolati in una logica puramente tecnica, ma integrati nel cuore dei processi di investimento e di gestione. È questa vicinanza che permette di trasformare i dati in un vero e proprio motore di performance.

Il primo ruolo chiave è quello del Data Owner aziendale. È responsabile di un perimetro critico di dati, come le partecipazioni, gli investitori o la pipeline. Definisce gli indicatori, le regole di gestione, i formati previsti e gli standard di qualità. Senza questo ruolo, i dati rimangono diffusi e difficili da sfruttare.

Il secondo ruolo è quello di Data / AI Lead. Guida la roadmap dei dati e dell'IA del fondo, stabilisce le priorità dei casi d'uso, arbitra la scelta degli strumenti e garantisce la coerenza generale. Agisce come punto di convergenza tra i team di investimento, il Middle Office, l'IR e le funzioni di supporto.

Un terzo ruolo sta emergendo intorno all'Operational Data Manager. Si trova nel cuore delle operazioni, spesso nel Middle Office, e garantisce che i flussi di dati siano raccolti, controllati, consolidati e diffusi correttamente. È responsabile della qualità operativa e della fluidità della catena dei dati.

Con l'IA, sta emergendo anche un ruolo più specifico di Business AI Champion. Non si tratta necessariamente di un profilo tecnico, ma di uno che padroneggia gli strumenti e il loro utilizzo. Aiuta i team ad adottare l'IA, a identificare i casi d'uso rilevanti e a formalizzare le best practice, in particolare per quanto riguarda la supervisione e i limiti degli agenti di IA.

Infine, sta diventando essenziale un ruolo interfunzionale per la governance dei dati e dell'IA. Ciò riguarda la tracciabilità, la sicurezza, la conformità e il controllo. In un contesto LP e normativo, la capacità di spiegare i dati o le decisioni sta diventando importante quanto la loro produzione.

Non è necessario creare immediatamente un team dedicato. Nella maggior parte dei fondi, questi ruoli emergono gradualmente dai team esistenti. La sfida consiste nell'individuare le responsabilità, chiarire gli ambiti e strutturare uno sviluppo mirato delle competenze.

Il punto chiave è garantire che siano radicati nell'azienda. Questi ruoli non devono essere isolati in una logica puramente tecnica, ma integrati nel cuore dei processi di investimento e di gestione. È questa vicinanza che permette di trasformare i dati in un vero e proprio motore di performance.