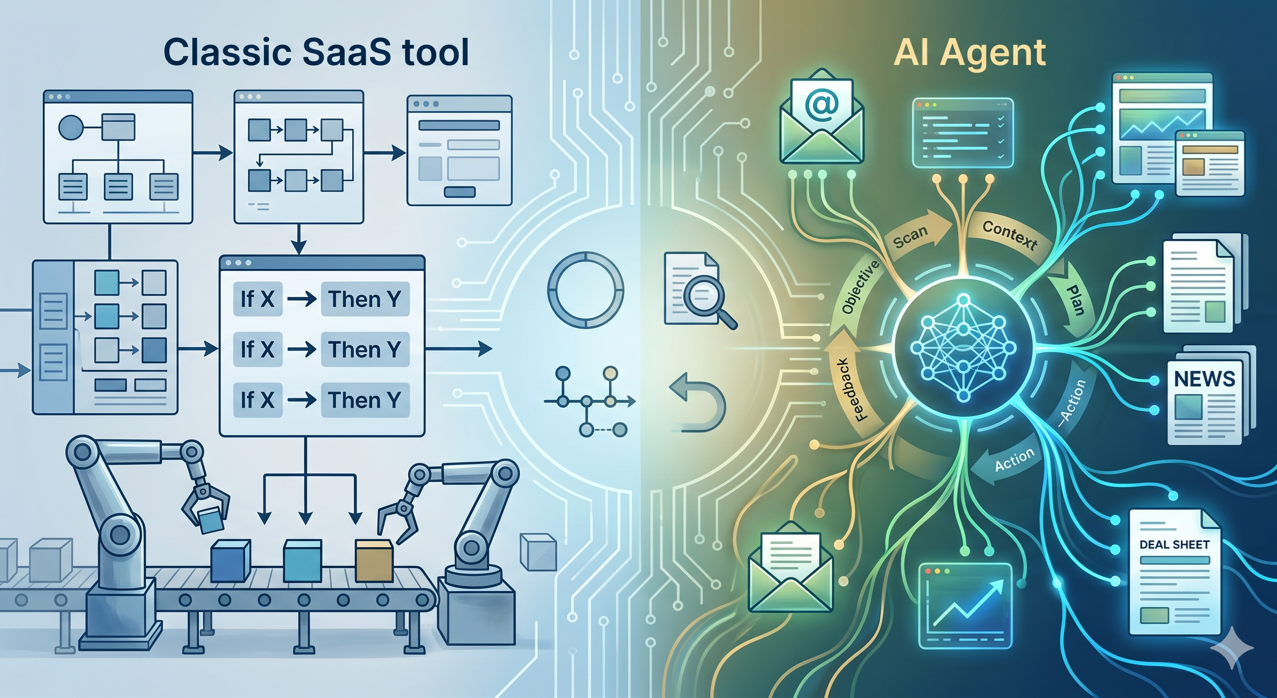

Che cos'è un agente AI nel contesto di un fondo e in che modo è diverso da uno strumento SaaS tradizionale?

Un SaaS tradizionale esegue azioni pre-programmate: se X, allora Y. Un agente AI, invece, riceve un obiettivo, comprende il contesto, pianifica i suoi passi ed esegue una sequenza di azioni adattandosi ai dati che incontra. Questa autonomia è allo stesso tempo un vantaggio e un rischio.

In un fondo, i casi d'uso rilevanti per un agente sono ben definiti: elaborare le e-mail dei fornitori, arricchire un foglio di trattativa, preparare automaticamente un pacchetto di commissioni da una data room, monitorare i segnali sulle aziende target. I casi mal inquadrati (prendere una decisione di investimento, inviare una comunicazione a un LP senza correggere) non sono casi per agenti, ma per esseri umani assistiti.

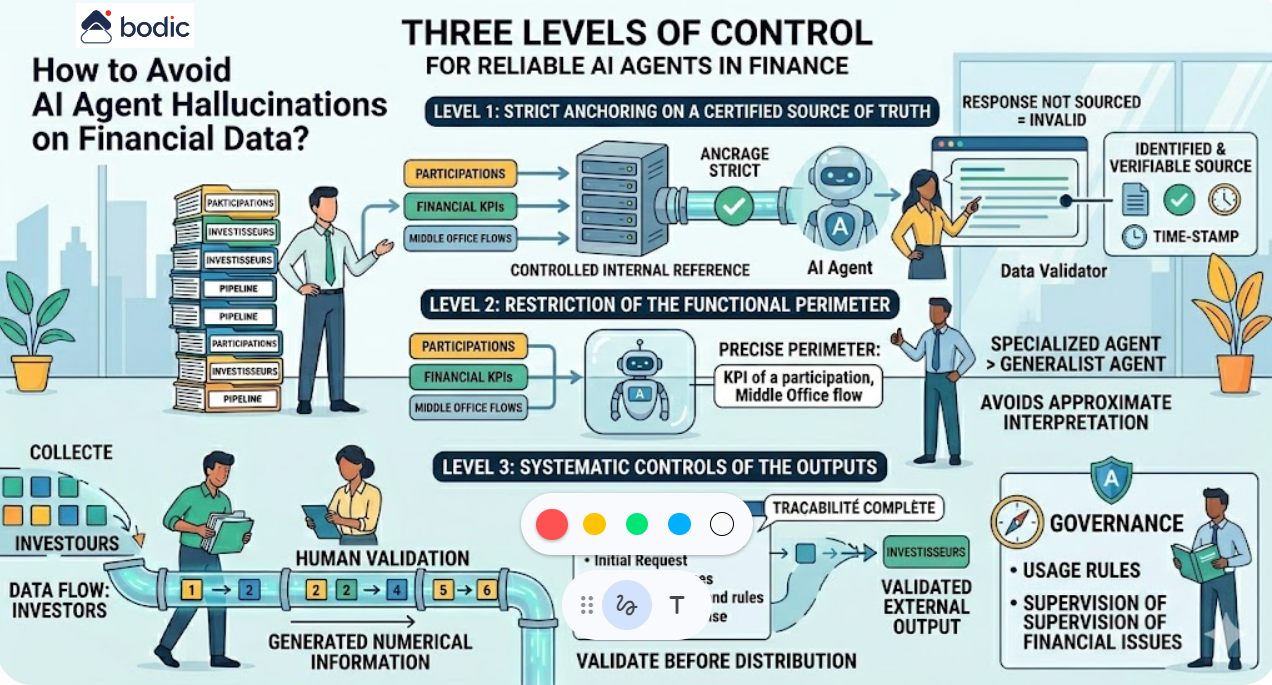

Un buon agente ha quattro caratteristiche: un perimetro chiaro, la supervisione umana in ogni fase sensibile, la piena tracciabilità e la reversibilità in caso di comportamento imprevisto. Bodic sviluppa i suoi agenti secondo questi principi come parte dei suoi sviluppi su misura.

In un fondo, i casi d'uso rilevanti per un agente sono ben definiti: elaborare le e-mail dei fornitori, arricchire un foglio di trattativa, preparare automaticamente un pacchetto di commissioni da una data room, monitorare i segnali sulle aziende target. I casi mal inquadrati (prendere una decisione di investimento, inviare una comunicazione a un LP senza correggere) non sono casi per agenti, ma per esseri umani assistiti.

Un buon agente ha quattro caratteristiche: un perimetro chiaro, la supervisione umana in ogni fase sensibile, la piena tracciabilità e la reversibilità in caso di comportamento imprevisto. Bodic sviluppa i suoi agenti secondo questi principi come parte dei suoi sviluppi su misura.