¿Qué nuevas funciones están surgiendo en un fondo con IA y Datos?

La introducción de la IA y los datos en un fondo no supone un cambio brusco en las líneas de negocio, pero sí da lugar a nuevas funciones en torno a la estructuración, la gobernanza y el uso operativo de los datos.

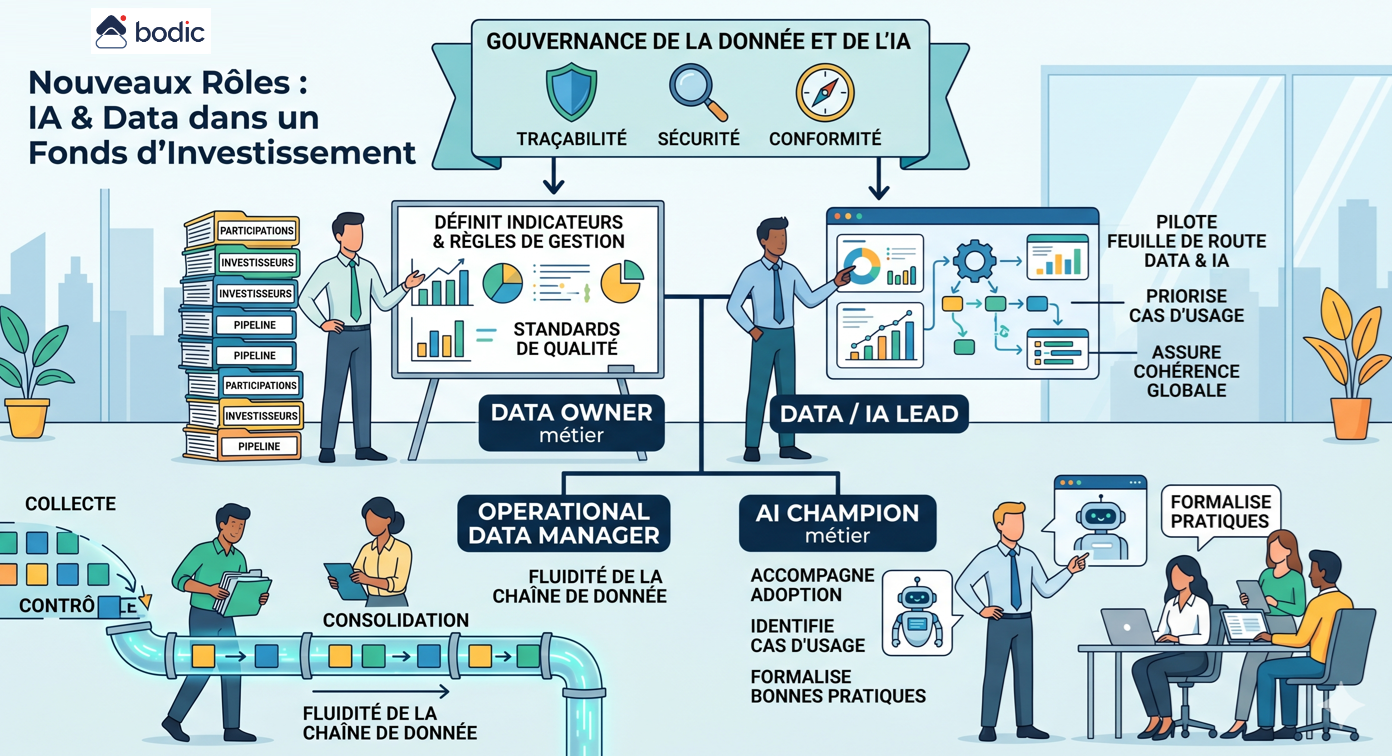

La primera función clave es la del propietario de los datos empresariales. Es el responsable de un perímetro crítico de datos, como las participaciones, los inversores o el pipeline. Define los indicadores, las reglas de gestión, los formatos esperados y las normas de calidad. Sin este papel, los datos siguen siendo difusos y difíciles de explotar.

La segunda función es la de Responsable de Datos/AI. Dirige la hoja de ruta de datos e IA del fondo, prioriza los casos de uso, arbitra la elección de herramientas y garantiza la coherencia general. Actúa como punto de convergencia entre los equipos de inversión, el Middle Office, IR y las funciones de apoyo.

Una tercera función está surgiendo en torno al Gestor de Datos Operativos. Está situado en el corazón de las operaciones, a menudo en el Middle Office, y garantiza que los flujos de datos se recopilan, controlan, consolidan y difunden correctamente. Es responsable de la calidad operativa y la fluidez de la cadena de datos.

Con la IA, también está surgiendo una función más específica de Business AI Champion. No se trata necesariamente de un perfil técnico, sino de alguien que domina las herramientas y sus usos. Ayudan a los equipos a adoptar la IA, a identificar los casos de uso pertinentes y a formalizar las mejores prácticas, sobre todo en lo que respecta a la supervisión y las limitaciones de los agentes de IA.

Por último, se está convirtiendo en esencial un papel interfuncional para la gobernanza de los datos y la IA. Esto abarca la trazabilidad, la seguridad, el cumplimiento y el control. En un contexto normativo y de LP, la capacidad de explicar los datos o una decisión se está volviendo tan importante como producirlos.

No hay necesidad inmediata de crear un equipo especializado. En la mayoría de los fondos, estas funciones surgen gradualmente de los equipos existentes. El reto consiste en determinar las responsabilidades, clarificar el alcance y estructurar el desarrollo de competencias específicas.

El punto clave es asegurarse de que estén arraigadas en el negocio. Estas funciones no deben estar aisladas en una lógica puramente técnica, sino integradas en el corazón de los procesos de inversión y gestión. Es esta proximidad la que permite transformar los datos en un verdadero motor de rendimiento.

La primera función clave es la del propietario de los datos empresariales. Es el responsable de un perímetro crítico de datos, como las participaciones, los inversores o el pipeline. Define los indicadores, las reglas de gestión, los formatos esperados y las normas de calidad. Sin este papel, los datos siguen siendo difusos y difíciles de explotar.

La segunda función es la de Responsable de Datos/AI. Dirige la hoja de ruta de datos e IA del fondo, prioriza los casos de uso, arbitra la elección de herramientas y garantiza la coherencia general. Actúa como punto de convergencia entre los equipos de inversión, el Middle Office, IR y las funciones de apoyo.

Una tercera función está surgiendo en torno al Gestor de Datos Operativos. Está situado en el corazón de las operaciones, a menudo en el Middle Office, y garantiza que los flujos de datos se recopilan, controlan, consolidan y difunden correctamente. Es responsable de la calidad operativa y la fluidez de la cadena de datos.

Con la IA, también está surgiendo una función más específica de Business AI Champion. No se trata necesariamente de un perfil técnico, sino de alguien que domina las herramientas y sus usos. Ayudan a los equipos a adoptar la IA, a identificar los casos de uso pertinentes y a formalizar las mejores prácticas, sobre todo en lo que respecta a la supervisión y las limitaciones de los agentes de IA.

Por último, se está convirtiendo en esencial un papel interfuncional para la gobernanza de los datos y la IA. Esto abarca la trazabilidad, la seguridad, el cumplimiento y el control. En un contexto normativo y de LP, la capacidad de explicar los datos o una decisión se está volviendo tan importante como producirlos.

No hay necesidad inmediata de crear un equipo especializado. En la mayoría de los fondos, estas funciones surgen gradualmente de los equipos existentes. El reto consiste en determinar las responsabilidades, clarificar el alcance y estructurar el desarrollo de competencias específicas.

El punto clave es asegurarse de que estén arraigadas en el negocio. Estas funciones no deben estar aisladas en una lógica puramente técnica, sino integradas en el corazón de los procesos de inversión y gestión. Es esta proximidad la que permite transformar los datos en un verdadero motor de rendimiento.