Résumé

Cette fiche fournit un aperçu détaillé de l’IA Act et de son application pratique, particulièrement dans le secteur du Private Equity. Elle souligne les échéances clés de la législation, notamment l’interdiction de certaines pratiques d’IA dès février 2025 et l’application progressive des obligations pour les modèles d’IA à usage général. Le texte présente une classification des systèmes d’IA en quatre catégories de risque (inacceptable, élevé, limité, minimal) et offre des conseils pratiques aux sociétés de gestion pour cartographier et gérer leurs cas d’usage de l’IA. Elle explique également les impacts concrets de l’IA Act sur les opérations internes, les due diligences, les relations avec les investisseurs, et la gouvernance, en insistant sur les risques d’extraterritorialité et de réputation. Enfin, la fiche positionne la conformité non seulement comme une obligation, mais aussi comme un avantage compétitif crucial pour renforcer la confiance et éviter de lourdes sanctions.

NB : le podcast de BODIC est généré par l’outil d’IA NotebookLM à partir du contenu de cette fiche PDF écrite par l’équipe Bodic

L’IA Act : Un texte qui entre dans le concret

2 février 2025 : interdiction des pratiques d’IA jugées “inacceptables” : manipulation cognitive, scoring social, reconnaissance faciale sans dérogation…

2 août 2025 : entrée en vigueur du deuxième volet sur les modèles d’IA à usage général (General Purpose AI – GPAI), avec obligations de transparence renforcées pour les fournisseurs.

2 août 2026 : application complète pour la plupart des obligations, y compris pour les GPAI et extension aux systèmes à haut risque intégrés dans certains produits réglementés

L’Europe renforce son approche précaution et confiance. Pour les sociétés de gestion, cela impacte la gouvernance, les due diligences et la conformité des participations.

Impact concret pour les sociétés de gestion

Cela ne relève pas seulement d’une contrainte réglementaire, c’est l’occasion de mieux cartographier les cas d’usage IA.

Savez-vous où se situent vos IA actuelles et futures dans ce cadre réglementaire ?

Risque inacceptable : Interdits

Exemples : manipulation comportementale, surveillance biométrique de masse

Risque élevé : Forte régulation

Exemples : Systèmes d’aide à la décision dans les secteurs sensibles : santé, recrutement, crédit, justice, sécurité, éducation

Risque limité : Obligations de transparence

Exemples : chatbot informant qu’ils font appel à de l’IA

Risque minimal : libre usage

Exemples : filtres anti-spam, aide bureautique, copilote sans décision critique

L’IA Act classe les systèmes en 4 catégories.

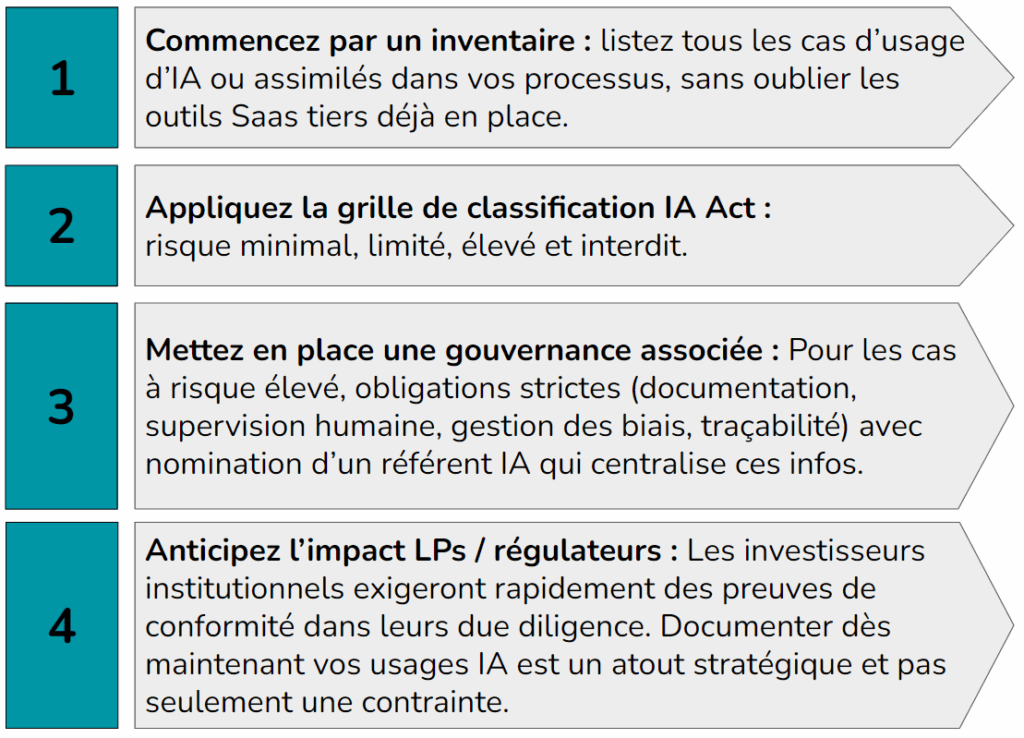

Conseils pratiques

Impacts pour les sociétés de gestion (1/2)

★ Outils internes : CRM avec IA, scoring d’investissement, copilotes internes souvent en risque limité, mais parfois élevé (Exemple : analyse automatique de CV ou de Deck).

★ Due diligence : Vérifier si une cible développe ou utilise une IA concernée par l’IA Act (même indirectement).

★ Portefeuille : Si une participation modifie substantiellement un modèle IA, elle devient “fournisseur” et elle hérite donc de nouvelles obligations.

★ Relation investisseurs : La transparence devient un gage de confiance LP, adaptez votre communication IR.

★ Gouvernance : Intégrer l’IA Act dans les politiques de conformité et dans la gestion des risques.

Impacts pour les sociétés de gestion (2/2)

★ Extraterritorialité : l’IA Act s’applique même si la cible est en dehors de l’UE dès lors que ses services (ou ses données) sont utilisés dans l’UE.

★ Responsabilité groupe : les amendes sont calculées potentiellement sur le chiffre d’affaires consolidé ⇒ vigilance au niveau du fonds.

★ Risque réputationnel : un incident IA peut toucher la marque du fonds, même si c’est la participation qui en est la cause.

★ Former vos équipes pour reconnaître les cas à risque en interne et chez vos partenaires.

À retenir

- L’IA Act est à la fois un cadre légal et un levier de confiance.

- Se préparer tôt, c’est éviter des sanctions lourdes (jusqu’à 35 M€ ou 7 % du CA mondial) et renforcer son attractivité auprès des LPs.

- Cartographier et classer vos cas d’usage IA est la première étape clé pour piloter vos risques et anticiper les obligations de gouvernance.

- Former vos équipes et documenter vos usages IA devient un avantage compétitif dans les relations investisseurs et les due diligences.

Vous souhaitez aller plus loin ?

BODIC vous accompagne pour mettre en place une démarche IA/Data efficace et souveraine, tout en aidant vos équipes à monter en compétences.

📩 Contactez-nous dès aujourd’hui : contact@bodic.eu

Télécharger la fiche en PDF :

Revenir à la liste de toutes les fiches IA DATA de Bodic